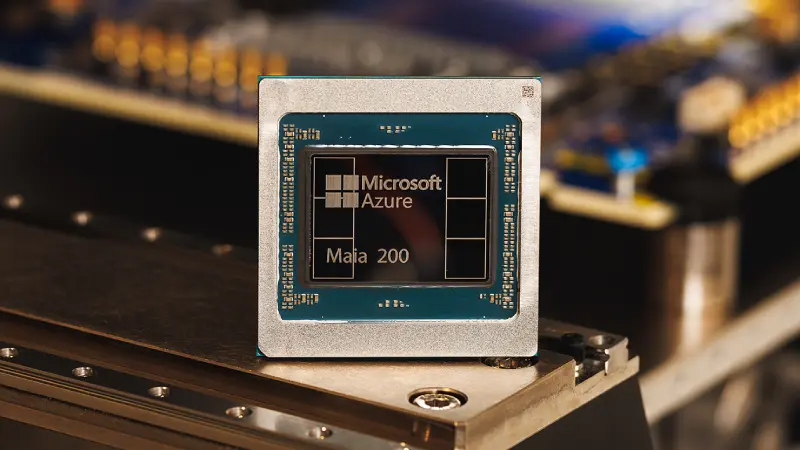

Microsoft Maia 200: El chip de 3nm que redefine la inferencia de IA en Azure

El mundo de la tecnología no descansa, y Microsoft acaba de dar un golpe en la mesa con el anuncio de su nuevo Maia 200. Este acelerador de inteligencia artificial de próxima generación no es solo una actualización; es un hito en la estrategia de silicio propio de la compañía, diseñado específicamente para que la inferencia de modelos a gran escala sea más rápida, eficiente y, sobre todo, barata.

Un monstruo de 3 nanómetros y 140 mil millones de transistores

Si te gustan los números impresionantes, el Maia 200 tiene de sobra. Fabricado con el avanzado proceso de 3 nanómetros de TSMC, este chip integra más de 140 mil millones de transistores. Esta densidad de potencia está pensada para responder a las exigencias brutales de la IA generativa moderna.

Para combatir el eterno problema del «cuello de botella» en el movimiento de datos, Microsoft ha rediseñado por completo el sistema de memoria:

- Memoria HBM3e: 216 GB de capacidad.

- SRAM integrada: 272 MB.

- Ancho de banda: Hasta 7 TB/s, lo que acelera drásticamente la generación de tokens.

Rendimiento Crudo

| Especificación | Rendimiento |

| Precisión FP4 | Más de 10 petaFLOPS |

| Precisión FP8 | Más de 5 petaFLOPS |

| Rendimiento por dólar | 30 % superior a la generación actual |

Optimizado para el futuro: GPT-5.2 y más allá

Lo más interesante del Maia 200 no es solo su potencia bruta, sino para qué se va a usar. Microsoft ha confirmado que este hardware será el encargado de ejecutar los modelos más avanzados, incluyendo el esperado GPT-5.2 de OpenAI.

Además, el chip será la columna vertebral de:

- Microsoft 365 Copilot: Mejorando la experiencia del usuario final y la eficiencia operativa.

- Microsoft Foundry: Optimizando los servicios de infraestructura.

- Microsoft Superintelligence: El equipo interno lo usará para generación de datos sintéticos y aprendizaje por refuerzo.

«Se trata del sistema de inferencia más eficiente que la compañía ha desplegado hasta ahora.»

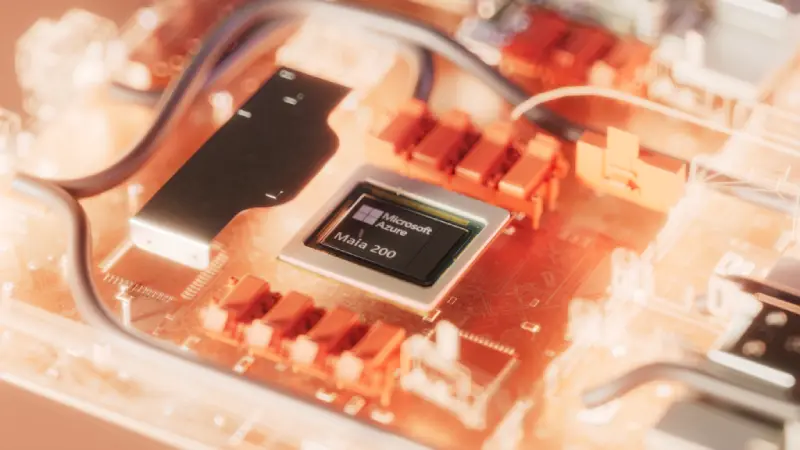

Escalabilidad a nivel de centro de datos

Microsoft no solo pensó en el chip individual, sino en cómo se conectan entre sí. La arquitectura de red de Maia 200 utiliza Ethernet estándar en dos niveles, permitiendo crear clústeres de hasta 6.144 aceleradores trabajando al unísono con una alta confiabilidad y menor consumo energético.

En cada bandeja de servidor, cuatro aceleradores están totalmente interconectados para maximizar el desempeño en tareas intensivas. Este enfoque integral simplifica la programación y reduce los costos operativos en toda la red global de Azure.

Disponibilidad

Actualmente, el Maia 200 ya está operando en la región US Central de Azure. Si no estás en esa zona, no te preocupes: Microsoft ya planea implementaciones próximas en US West 3 y otras regiones internacionales.